Mitglied werden

Driverless

Autonomes Fahren: Hardware, Softwareentwicklung zum selbstständigen Fahren und Testing im Team.

Wer sind wir?

Wir zählen Studierende aus Bachelor- und Masterstudiengängen aus verschiedenen Fachrichtungen wie Maschinenbau, Informatik, Elektrotechnik und Verkehrsingenieurswesen. Zu unseren Aufgaben zählt die Konzepterstellung und Implementation des autonomen Systems, die Softwareentwicklung zum selbstständigen Fahren sowie Thematiken wie dem Testing. Bei uns zählt das Wir, weshalb die meisten Entscheidungen im Team getroffen werden. Aufgrund des kurzen Bestehens sind wir immer noch in der Aufbau-Phase unseres Moduls, in welcher du einen großen Beitrag leisten kannst. Weiter unten siehst du nochmal alle unsere Themengebiete etwas detaillierter.

Was machen wir und wo kannst du mitmachen?

Hardware

Das Fahrzeug verfügt über verschiedene Sensoriken um die Eigenbewegungen wahrzunehmen und die Umgebung zu erkennen. Diese Daten werden in einer vergleichsweise starken Recheneinheit verarbeitet und eine Vorgabe für die Fahrtroute aus der Trajektorienplanung ausgegeben. Die Ausgabewerte werden von einer kleinen, schwächeren Recheneinheit weiterverarbeitet, welche dar auffolgend die Motoren sowie die Aktorik des Fahrzeugs regelt. Hierbei wird die von der starken Recheneinheit ausgegebene Fahrtroute mit reellen Werten beim Fahren umgesetzt. Die Aktorik der Lenkung besteht aus einem Elektromotor, welcher über ein Getriebe den Lenkwinkel einstellt. Die Beschleunigung des Fahrzeugs wird durch eine elektrische Ansteuerung der Motoren realisiert. Das Verzögern ist durch Rekuperation bis zu einem bestimmten Wert ebenfalls durch die Motoren möglich. Zusätzliche negative Beschleunigungen werden durch pneumatische Schaltungen der mechanischen Bremse erzielt. Darüberhinaus verfügt das Fahrzeug aufgrund des Reglements über eine Sicherheitsbremse sowie über Leuchtsignale zum signalisieren des aktuellen Fahrzustands für Aussenstehende.

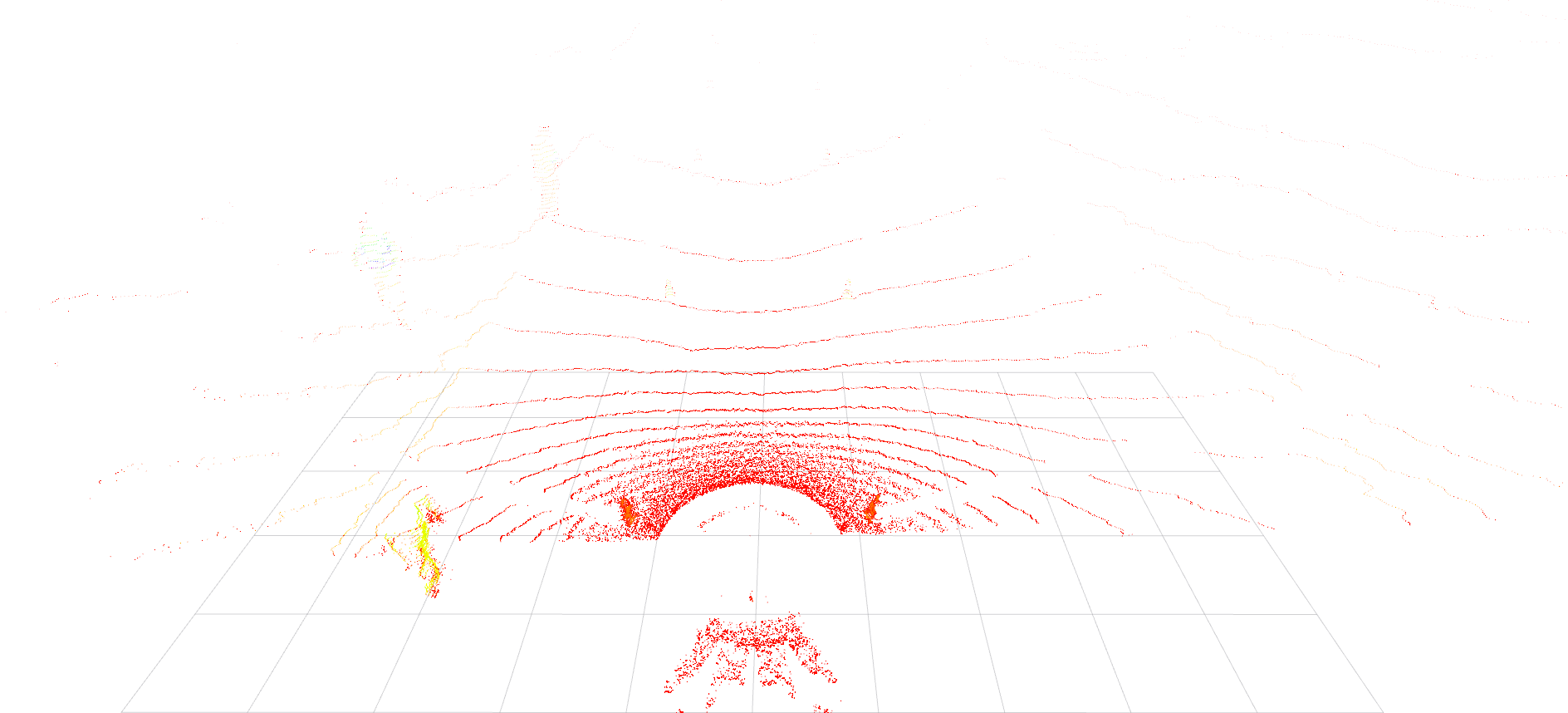

Objekterkennung

Wir benutzen einen Ouster LS1 64 Lidar und eine ZED Stereofarbkamera für unsere beiden Objekterkennungspipelines. Die Punktwolke des Lidars wird mit einem Clustering-Algorithmus ausgewertet um eine genaue Position der Hütchen vor dem Auto zu erhalten. Das Kamerabild wird mit einem StateOfTheArt Neuronalen Netz verarbeitet um die Daten des Lidar zu erweitern.

Trajektorie

In der Trajektorienplanung wird mithilfe des Delauney Triangulations-Algorithmuses die Fahrroute des Fahrzeugs prädiktiv vorausberechnet. Hierfür dienen die Positionen der Hütchen aus der Object Detection sowie der aktuelle Fahrzeugstatus und die eigene Lokalisierung aus der Vehicle State Estimation & Localisation als Eingangswerte. Ausgangswerte stellen die für jeden Zeitschritt berechneten Lenkwinkel und positiven und negativen Beschleunigungen dar, welche vom Fahrzeug ausgeführt werden sollen.

Vehicle State Estimation und Localisation

Bei der Vehicle State Estimation and Localisation werden die Daten aus INS (Inertial Navigation System), GPS, sowie Drehzahl und weiteren Sensoren zusammengeführt, um die Position auf einer Globalen Karte zu bestimmen. Zur “Sensor Fusion” wird ein Kalman Filter verwendet der die Daten “fusioniert” und somit genauere Werte ausgibt und auch eine Wahrscheinlichkeit voraus berechnet.